O serviço de mídia social Snap disse na terça-feira que planeja adicionar marcas d’água às imagens geradas por IA em sua plataforma.

A marca d'água é uma versão translúcida do logotipo Snap com um emoji brilhante e será adicionada a qualquer imagem gerada por IA exportada do aplicativo ou salva no rolo da câmera.

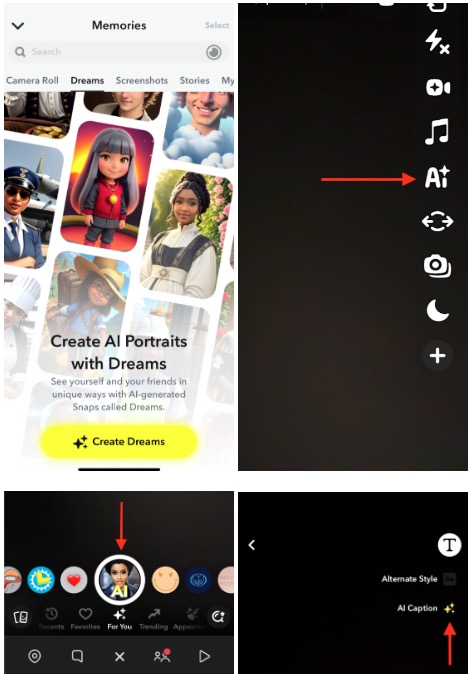

A marca d'água, que é o logotipo do Snap com brilho, denota imagens geradas por IA criadas usando as ferramentas do Snap. Créditos da imagem: Foto

Em sua página de suporte, a empresa disse que remover a marca d’água das imagens violaria seus termos de uso. Não está claro como o Snap detectará a remoção dessas marcas d'água. Pedimos mais detalhes à empresa e atualizaremos esta história quando recebermos resposta.

Outros gigantes da tecnologia como Microsoft, Meta e Google também tomaram medidas para rotular ou identificar imagens criadas com ferramentas baseadas em IA.

Atualmente, o Snap permite que assinantes pagantes criem ou editem imagens geradas por IA usando Snap AI. Seu recurso focado em selfies, Dreams, também permite que os usuários usem IA para incrementar suas fotos.

Em uma postagem no blog descrevendo suas práticas de segurança e transparência em torno da IA, a empresa explicou que mostra recursos alimentados por IA, como lentes, com um marcador visual que lembra um emoji brilhante.

Snap lista indicadores para recursos alimentados por IA generativa. Créditos da imagem: Foto

A empresa disse que também adicionou cartões de contexto às imagens geradas por IA criadas com ferramentas como o Dream para melhor informar os usuários.

Em fevereiro, a Snap fez parceria com a HackerOne para adotar um programa de recompensas de bugs destinado a testar a resistência de suas ferramentas de geração de imagens de IA.

“Queremos que Snapchatters de todas as esferas da vida tenham acesso e expectativas equitativos ao usar todos os recursos do nosso aplicativo, especialmente nossas experiências baseadas em IA. Com isso em mente, estamos implementando testes adicionais para minimizar resultados de IA potencialmente tendenciosos”, disse a empresa na época.

Os esforços do Snapchat para melhorar a segurança e moderação da IA vieram depois que seu chatbot “My AI” gerou alguma controvérsia após o lançamento em março de 2023, quando alguns usuários conseguiram fazer o bot responder e falar sobre sexo, bebida e outros assuntos potencialmente inseguros. Mais tarde, a empresa implementou controles no Family Center para que pais e responsáveis monitorem e restrinjam as interações de seus filhos com a IA.