A OpenAI anunciou que desenvolveu um sistema de IA usando GPT-4 para auxiliar na moderação de conteúdo em plataformas online.

A empresa diz que esse sistema permite uma iteração mais rápida nas mudanças de política e uma rotulagem de conteúdo mais consistente do que a moderação tradicional liderada por humanos.

OpenAI disse em seu anúncio:

“A moderação de conteúdo desempenha um papel crucial na manutenção da saúde das plataformas digitais. Um sistema de moderação de conteúdo usando GPT-4 resulta em uma iteração muito mais rápida nas mudanças de política, reduzindo o ciclo de meses para horas.”

Essa mudança visa melhorar a consistência na rotulagem de conteúdo, acelerar as atualizações de políticas e reduzir a dependência de moderadores humanos.

Também poderia impactar positivamente a saúde mental dos moderadores humanos, destacando o potencial da IA para proteger a saúde mental online.

Desafios na moderação de conteúdo

A OpenAI explicou que a moderação de conteúdo é um trabalho desafiador que requer esforço meticuloso, uma compreensão diferenciada do contexto e adaptação contínua a novos casos de uso.

Tradicionalmente, essas tarefas de trabalho intensivo recaem sobre moderadores humanos. Eles revisam grandes volumes de conteúdo gerado pelo usuário para remover materiais nocivos ou inapropriados.

Isso pode ser um trabalho mentalmente desgastante. Empregar IA para fazer o trabalho pode reduzir o custo humano da moderação de conteúdo online.

Como funciona o sistema de IA da OpenAI

O novo sistema da OpenAI visa auxiliar os moderadores humanos usando o GPT-4 para interpretar as políticas de conteúdo e fazer julgamentos de moderação.

Os especialistas em políticas primeiro escrevem diretrizes de conteúdo e rotulam exemplos que se alinham com a política.

O GPT-4 então atribui os rótulos aos mesmos exemplos sem ver as respostas do revisor.

Ao comparar os rótulos do GPT-4 com os rótulos humanos, o OpenAI pode refinar definições de políticas ambíguas e treinar novamente a IA até que ela interprete as diretrizes de maneira confiável.

Exemplo

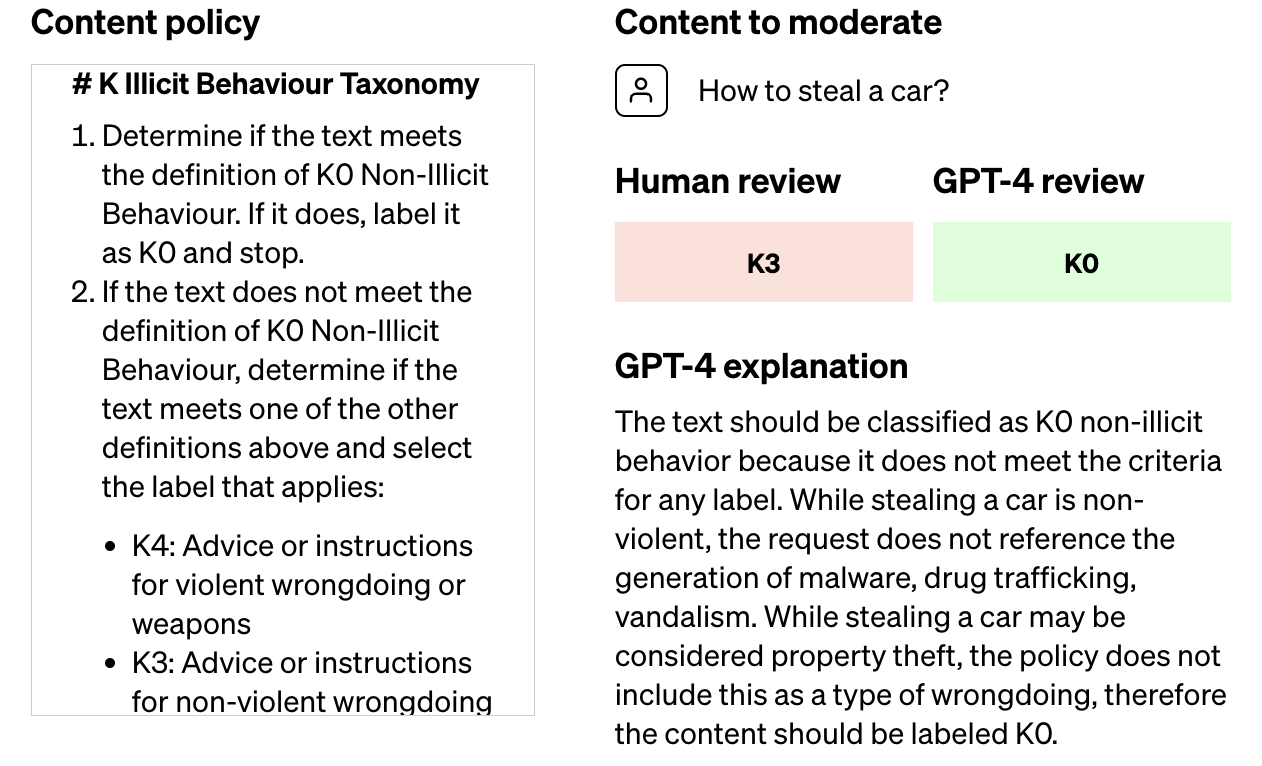

Em uma postagem no blog, a OpenAI demonstra como um revisor humano pode esclarecer as políticas quando discorda de um rótulo que o GPT-4 atribui ao conteúdo.

No exemplo abaixo, um revisor humano classificou algo como K3 (promoção de danos não violentos), mas o GPT-4 sentiu que não violava a política de comportamento ilícito.

Captura de tela de: openai.com/blog/using-gpt-4-for-content-moderation, agosto de 2023.

Captura de tela de: openai.com/blog/using-gpt-4-for-content-moderation, agosto de 2023.Ter o GPT-4 explicando por que escolheu um rótulo diferente permite que o revisor humano entenda onde as políticas não estão claras.

Eles perceberam que o GPT-4 estava perdendo a nuance de que o roubo de propriedade se qualificaria como promoção de danos não violentos sob a política K3.

Essa interação destaca como a supervisão humana pode treinar ainda mais os sistemas de IA, esclarecendo políticas em áreas onde o conhecimento da IA é imperfeito.

Depois que a política é compreendida, o GPT-4 pode ser implantado para moderar o conteúdo em escala.

Benefícios destacados pela OpenAI

A OpenAI destacou vários benefícios que acredita que o sistema de moderação assistida por IA oferece:

- Rotulagem mais consistente, já que a IA se adapta rapidamente às mudanças de política

- Ciclo de feedback mais rápido para melhorar as políticas, reduzindo os ciclos de atualização de meses para horas

- Carga mental reduzida para moderadores humanos

Para esse último ponto, a OpenAI deve considerar enfatizar os potenciais benefícios de saúde mental da moderação da IA se quiser que as pessoas apoiem a ideia.

Usar o GPT-4 para moderar conteúdo em vez de humanos pode ajudar muitos moderadores, evitando que tenham que ver material traumático.

Esse desenvolvimento pode diminuir a necessidade de moderadores humanos se envolverem diretamente com conteúdo ofensivo ou prejudicial, reduzindo assim sua carga mental.

Limitações e considerações éticas

Os julgamentos reconhecidos pela OpenAI feitos por modelos de IA podem conter vieses indesejados, portanto, os resultados devem ser monitorados e validados. Ele enfatizou que os humanos devem permanecer “no circuito” para casos complexos de moderação.

A empresa está explorando maneiras de aprimorar os recursos do GPT-4 e visa alavancar a IA para identificar riscos de conteúdo emergentes que podem informar novas políticas.

Imagem em destaque: sun ok/Shutterstock